AI外観検査 3Dプリントで「目視」を卒業する。印刷後品質管理の自動化

AI外観検査 3Dプリントで「目視」を卒業する。印刷後品質管理の自動化

あなたの3Dプリンターは、いつも完璧なパーツを出力していますか?

実際、正直に答えるなら、答えは「ノー」でしょう。FDM方式で出力されたパーツには、レイヤーシフト、ストリンギング、反り、デラミネーション――無数の欠陥が潜んでいます。問題は、人間の目がそれを正しく検出できないことです。照明の角度、疲労度、「この程度なら許容範囲だろう」という主観的バイアス。目視検査とは、品質管理の名を借りた「気分次第のギャンブル」に他なりません。

つまり、本記事では、AI外観検査 3Dプリントの技術を用いて、印刷「後」の品質管理を完全に自動化するアプローチを解説します。重要な前提として、本記事が扱うのは印刷後(post-process)の外観検査であり、印刷中(in-process)のスパゲッティ検出とは明確に異なる領域です。ObicoやBambu Labの内蔵カメラが「印刷中の異常を止める」技術であるのに対し、ここで扱うのは「完成品が品質基準を満たしているかを判定する」技術です。

「目視検査」の限界――なぜ人間の目はプリント品質を見誤るのか

主観性という構造的欠陥

例えば、品質管理ラインに立つ検査員は、1日に数百から数千個のパーツを目視で確認します。この作業の問題は、「見落とし」ではなく「判断基準のブレ」にあります。

さらに、3Dプリントの欠陥は微妙な側面もあります。0.3mmのレイヤーシフトは、光の当たり方次第で見えたり見えなかったりします。ストリンギング(糸引き)の許容レベルは検査員によって異なり、朝の検査と夕方の検査で合否判定が変わることも珍しくありません。ある研究では、同一パーツに対する目視検査の再現性(同じ検査員が同じ判定を下す確率)は70〜85%にとどまると報告されています。

つまり、目視検査は確率的に「正解を外す」仕組みなのです。

微細欠陥の検出限界

事実、人間の目の空間分解能は、最良条件で約0.1mm程度です。しかし、FDMプリントにおいて品質に影響を与える欠陥の多くは、この閾値付近かそれ以下に存在します。

| 欠陥タイプ | 典型的なサイズ | 目視検出の難易度 |

|---|---|---|

| レイヤーシフト | 0.1〜1.0mm | 0.3mm以下は困難 |

| アンダーエクストルージョン | 0.05〜0.3mm幅の隙間 | 照明条件に強く依存 |

| デラミネーション(層間剥離) | 表面下の内部欠陥 | 目視ではほぼ不可能 |

| ストリンギング | 0.1〜0.5mm径の糸 | 背景色とのコントラスト次第 |

| ブロブ/ジッツ | 0.2〜1.0mm突起 | 反復パターンの見落とし多発 |

特に、とりわけ致命的なのは、デラミネーション(層間剥離)です。これは内部の層間接着不良であり、表面からは正常に見えても、荷重をかけた瞬間に破断します。目視検査では原理的に検出できません。

プリントファームにおけるスケーラビリティの壁

もちろん、1台のプリンターを趣味で使う場合、目視検査は「面倒だがなんとかなる」レベルです。しかし、家庭用「ダークファクトリー」の実現で解説したようなプリントファーム環境では、話が根本的に変わります。

具体的には、5台のプリンターが24時間稼働し、1日に20〜30個のパーツを生産する環境を想像してください。毎朝ベッドから起き上がって、30個のパーツを一つひとつ手に取り、回転させ、すべての面を確認する。この作業だけで30分から1時間が消えます。そして、その検査結果は前述の通り「気分次第」です。

つまり、ここに、コンピュータビジョンによる自動検査の必然性があります。

コンピュータビジョンが可能にした「欠陥の定量化」

YOLOアーキテクチャの進化と3Dプリント適用

実際、物体検出の代名詞であるYOLO(You Only Look Once)シリーズは、3Dプリント欠陥検出においても急速に成果を上げています。2024年から2025年にかけて発表された主要な研究結果を整理します。

| モデル | mAP@0.5 | mAP@0.5:0.95 | 精度(Precision) | FPS | 出典 |

|---|---|---|---|---|---|

| YOLOv11s | 83.08% | 53.61% | — | — | Springer, J. Intelligent Manufacturing (2024) |

| YOLOv11m | — | — | 91.28% | — | 同上 |

| 改良YOLOv8 | 97.5% (mAP50) | — | — | +18.1% (FPS向上) | IJAMT (2024) |

| 改良YOLOv8 (MDPI) | 91.7% (mAP50) | — | — | 71.9 FPS | MDPI (2024) |

| Vision Transformer (ViT) | — | — | 95.98% (accuracy) | — | Nature npj Adv. Manufacturing (2025) |

精度と軽量化の両立

さらに、ここで注目すべきは二点です。まず、改良YOLOv8がmAP50で97.5%という驚異的な精度を達成しつつ、GFLOPsを32.9%削減している点。これは「より正確に、より軽く」という理想的な進化方向を示しています。

また、次に、Vision Transformer(ViT)がCNNベースのYOLOとは異なるアプローチで95.98%のaccuracyを達成している点です。Nature npj Advanced Manufacturing(2025年)に掲載されたこの研究では、900サンプル規模のデータセットでViTが95.98%、CNNベースラインが95.90%とほぼ拮抗しており、Transformerの優位性はデータ規模が小さい条件(180~300サンプル)でより顕著に現れます。Transformerアーキテクチャが3Dプリント欠陥のような「テクスチャの微細な異常」の検出にも有効であることを示した点は重要です。

データセットの成熟

一方で、AI外観検査 3Dプリントの精度を支えるのは、高品質なデータセットです。この分野は2025年に大きな転換点を迎えました。

例えば、従来の主要データセットは、Kaggleの「FDM 3D Printing Defect Dataset」(作成者: wengmhu、5つの欠陥タイプ)や、Roboflowの「HCMUT 3D Printing Defects」(5,900枚、spaghetti/stringing/zitsの3カテゴリ)など、比較的小規模なものに限られていました。

しかし、状況を一変させたのが、2025年にarXivで公開された3D-ADAMデータセットです。14,120スキャン、217パーツ、27,346アノテーション済み欠陥を12カテゴリに分類したこのデータセットは、初めて「産業規模」と呼べるスケールを実現しました。従来のデータセットが数千枚規模だったことを考えると、一桁上の量的飛躍です。

さらに、3D-ADAMの意義は量だけではありません。12カテゴリという細粒度の欠陥分類により、「ストリンギング」と「ブロブ」のような類似欠陥を区別するモデルの訓練が初めて現実的になりました。

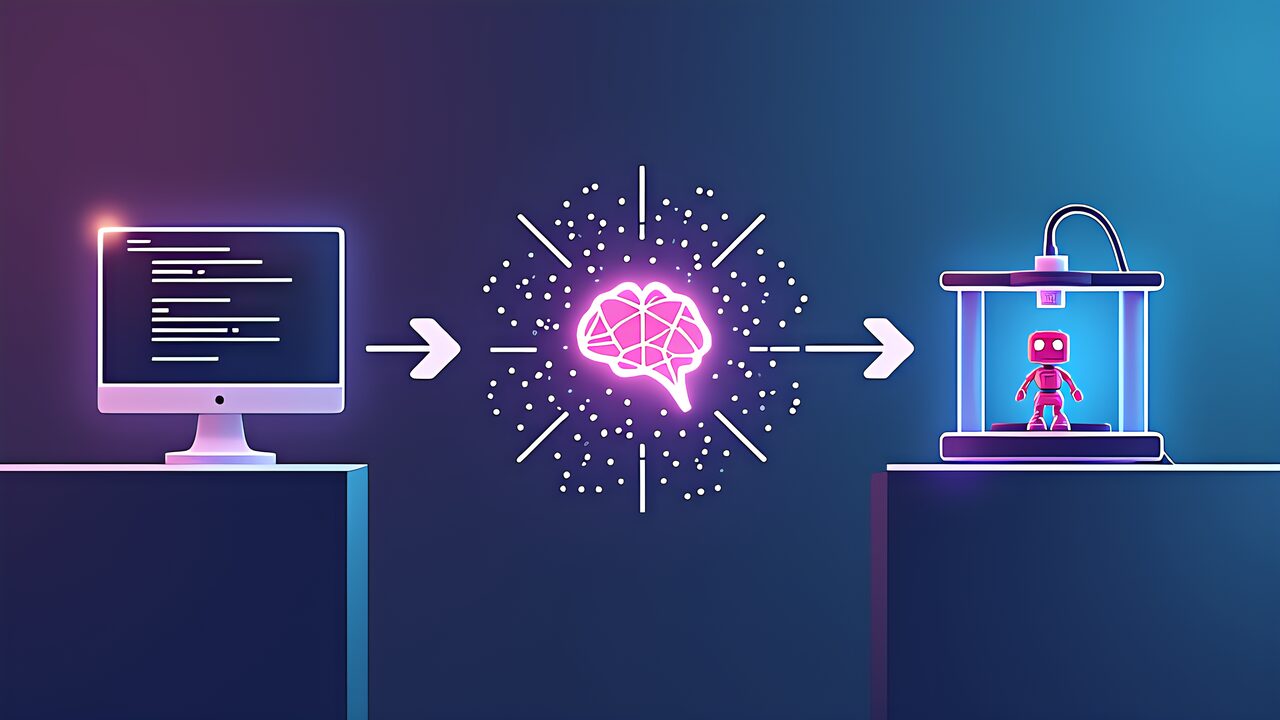

「印刷中」と「印刷後」の技術的断絶

しかし、ここで、本記事の核心に触れます。既存のAI検査ソリューションは、ほぼすべてが「印刷中(in-process)」の異常検出に特化しています。

- Obico(旧Spaghetti Detective): 100,000人以上のユーザー、100万件以上の失敗を検出。ただし印刷中のリアルタイム監視のみ

- PrintWatch: 機械学習による印刷中の欠陥検出。印刷後のベッドチェック機能はベータ版

- BedCheckAI: ベッドが空いているかどうかの確認。品質検査ではない

- Bambu Lab内蔵カメラ: NPUによるスパゲッティ検出。印刷中のみ

- SimplyPrint: クラウドベースのspaghetti/warping/blobbing検出。やはり印刷中のみ

また、24時間プリンター監視AIエージェントで詳述したように、これらのツールは「失敗した印刷を途中で止める」には極めて有効です。しかし、「完成したパーツが品質基準を満たしているかを自動判定する」機能は、いずれも提供していません。

産業向けソリューションの限界

同様に、商用の産業向けソリューションも同様の偏りがあります。Phase3Dは金属PBF向けの構造光方式、Inkbitは産業用レジン向け(カメラ4台+レーザー2基)、いずれもコンシューマFDMの印刷後検査を対象としていません。

結論として、コンシューマFDMにおける印刷後AI外観検査は、2026年時点で明確なオープンギャップです。既存のOctoPrintプラグインでは対応できず、商用ソリューションも存在しない。だからこそ、自分で構築する価値があるのです。

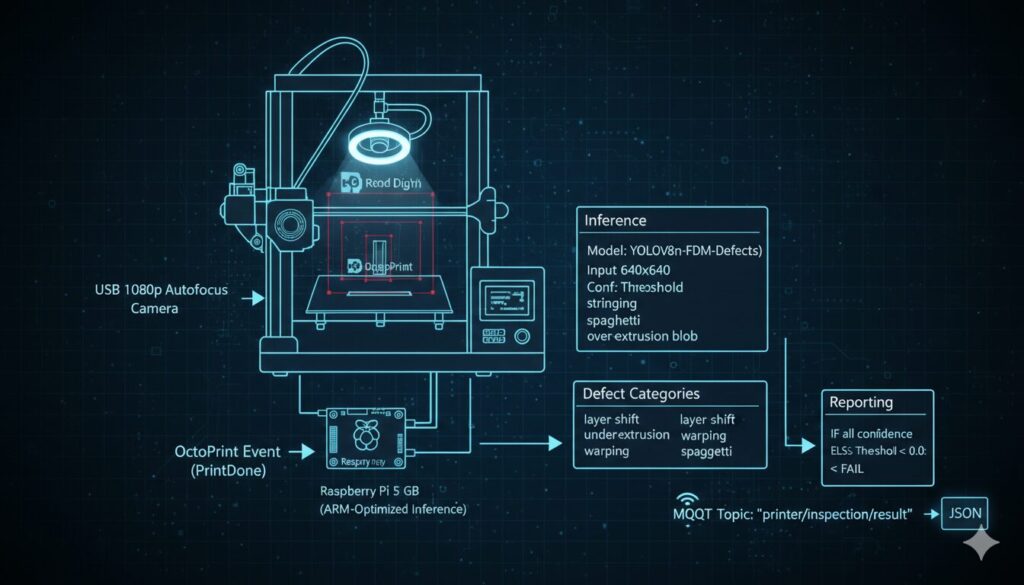

実践ガイド:Raspberry Pi 5 + USBカメラで作る自動検査ステーション

ハードウェア構成と費用

まず、AI外観検査 3Dプリントのステーションを構築するために必要なハードウェアは、驚くほどシンプルです。

| コンポーネント | 推奨製品 | 価格目安 | 理由 |

|---|---|---|---|

| ボードPC | Raspberry Pi 5 (8GB) | 約80ドル | ARM Cortex-A76 2.4GHz、NCNNランタイム対応 |

| カメラ | USB Webカメラ(1080p以上) | 約30ドル | オートフォーカス付き推奨 |

| LED照明 | リングライト(色温度5000K) | 約15ドル | 一定照明条件の確保 |

| カメラマウント | フレキシブルアーム | 約10ドル | ベッド上方からの俯瞰撮影 |

| microSDカード | 64GB A2クラス | 約15ドル | NCNNモデル格納用 |

| 合計 | 約150〜200ドル |

加えて、オプションとして、Raspberry Pi AI Kit(Hailo-8L搭載、13 TOPS)を約70ドルで追加すると、推論速度が劇的に向上します。ただし後述する通り、印刷後検査では1秒に1枚程度の処理速度で十分であり、CPU-onlyでの運用が現実的です。

推論性能:CPU vs. AI Kit

実際、Raspberry Pi 5における推論パフォーマンスは、用途に応じて二つの選択肢があります。

CPU-only(NCNNランタイム):

– YOLOv8n / YOLO11n @ 640×640: 約10〜12 FPS

– 消費電力: 約5W

– 追加コスト: なし

Hailo-8L AI Kit:

– YOLOv8n @ 640×640: 約136.7 FPS

– 演算能力: 13 TOPS

– 追加コスト: 約70ドル

したがって、印刷後の外観検査では、完成品を1枚撮影して分析するだけです。リアルタイムの動画ストリーム処理は不要であり、1推論あたり約100msのCPU-onlyで十分に実用的です。AI Kitの投資が正当化されるのは、プリントファームで5台以上のプリンターから連続的に検査画像が送られてくるような高スループット環境に限られるでしょう。

撮影環境の標準化

つまり、コンピュータビジョンの精度は、モデルの性能以上に「入力画像の品質」に左右されます。検査ステーションの撮影環境を標準化するために、以下の条件を固定してください。

- 照明の固定: リングライト(5000K、CRI 90以上)をカメラと同軸に配置し、影の発生を最小化する

- 背景の統一: 白または黒の無地マットをベッド上に敷く。PEIベッドの反射はノイズ源になる

- カメラ距離の固定: ベッド中心から垂直に200〜250mmの高さに固定。ビルドボリューム全体をフレーム内に収める

- ホワイトバランスの手動固定: 自動調整を無効化し、5000Kに手動設定する

つまり、これらの条件が毎回同一であることが、検出精度の再現性を保証します。

ソフトウェアスタック構成

検査フローの実装

import timefrom pathlib import Pathfrom dataclasses import dataclass@dataclassclass DefectResult: category: str confidence: float bbox: tuple # (x1, y1, x2, y2)class PostProcessInspector: """ 印刷完了後の外観検査を実行する。 OctoPrintのPrintDoneイベントをトリガーに起動。 """ def __init__(self, config_path: str): self.config = self._load_config(config_path) self.model = self._load_ncnn_model( self.config["inference"]["model"] ) def capture_image(self) -> Path: """ 印刷完了後、冷却時間を待ってから 1枚の高解像度画像を撮影する。 """ delay = self.config["capture"]["delay_after_print"] time.sleep(delay) # ベッド冷却を待つ image_path = Path("/tmp/inspection_latest.jpg") # USBカメラから1080p静止画を取得 self._capture_from_usb(image_path) return image_path def detect_defects( self, image_path: Path ) -> list[DefectResult]: """ NCNN推論エンジンで欠陥検出を実行。 640x640にリサイズ後、7カテゴリの欠陥を検出。 """ img = self._preprocess(image_path, size=640) raw_results = self.model.inference(img) defects = [] for det in raw_results: if det.confidence >= self.config[ "inference" ]["confidence_threshold"]: defects.append(DefectResult( category=det.class_name, confidence=det.confidence, bbox=det.bbox )) return defects def judge_quality( self, defects: list[DefectResult] ) -> dict: """ 検出された欠陥に基づいて合否判定を行う。 全欠陥のconfidenceが閾値以下なら PASS。 """ critical_defects = [ d for d in defects if d.category in ( "layer_shift", "delamination", "warping" ) ] cosmetic_defects = [ d for d in defects if d.category in ( "stringing", "over_extrusion_blob" ) ] verdict = "PASS" if critical_defects: verdict = "FAIL" elif len(cosmetic_defects) > 3: verdict = "REVIEW" return { "verdict": verdict, "critical_count": len(critical_defects), "cosmetic_count": len(cosmetic_defects), "defects": [ { "type": d.category, "confidence": round(d.confidence, 3), "location": d.bbox } for d in defects ] } def run_inspection(self) -> dict: """ 撮影→検出→判定の一連のフローを実行する。 """ image = self.capture_image() defects = self.detect_defects(image) result = self.judge_quality(defects) self._publish_result(result) return result欠陥の重要度分類と自動判定

特に、この実装のポイントは、欠陥を「致命的欠陥(critical)」と「外観上の欠陥(cosmetic)」に分類している点です。レイヤーシフトやデラミネーション、反りは構造的健全性に影響するため即座にFAIL判定。ストリンギングやブロブは外観品質の問題であり、一定数以下なら許容するREVIEW判定を設けています。

欠陥分類の精度検証:7大欠陥カテゴリの検出性能

7カテゴリの定義と特徴

具体的には、AI外観検査 3Dプリントのシステムが対象とする主要な欠陥カテゴリは、学術文献と実務経験の両面から以下の7つに集約されます。

| # | 欠陥カテゴリ | 日本語 | 原因 | 検出難易度 |

|---|---|---|---|---|

| 1 | Layer Shift | レイヤーシフト | ベルトの緩み、脱調 | 中(0.3mm以上で容易) |

| 2 | Under-Extrusion | アンダーエクストルージョン | フィラメント供給不足、ヒートクリープ | 高(微細な隙間) |

| 3 | Warping | 反り | 不均一な冷却収縮 | 中(底面の反りは俯瞰で見えにくい) |

| 4 | Stringing | ストリンギング | 不適切なリトラクション設定 | 低(細い糸は高コントラスト) |

| 5 | Spaghetti | スパゲッティ化 | ベッド定着不良、造形崩壊 | 低(大規模な異常) |

| 6 | Over-Extrusion / Blobs | 過押出/ブロブ | フロー過多、Z-seam | 中(反復パターンの検出) |

| 7 | Delamination | デラミネーション(層間剥離) | 層間接着不良、温度不足 | 最高(表面下の欠陥) |

なお、補足として、Elephant’s Foot(象の足)やZ-seam visibility(Z継ぎ目の可視性)も実務上は問題になりますが、現在の主要MLデータセットではカバーが薄く、検出モデルの訓練データが不足しています。

カテゴリ別の検出戦略

ただし、すべての欠陥を単一のモデルで均等に検出することは、現時点では困難です。カテゴリごとに最適な検出戦略が異なるためです。

まず、コントラストが高い欠陥(ストリンギング、スパゲッティ):

YOLOベースの物体検出が最も得意とする領域です。背景との境界が明確であり、mAP50で90%以上の検出精度が安定して得られます。改良YOLOv8の97.5%(IJAMT 2024)という数値は、この種の高コントラスト欠陥が含まれるデータセットでの評価です。

テクスチャ異常と構造的欠陥への対応

次に、テクスチャ異常(アンダーエクストルージョン、過押出):

物体検出よりもセグメンテーション(領域分割)のアプローチが有効です。正常な積層パターンからの逸脱を、ピクセルレベルで識別する必要があります。Vision Transformer(ViT)が95.98%のaccuracyを達成した(Nature npj Advanced Manufacturing, 2025)背景には、Transformerのグローバルアテンション機構が、画像全体の「テクスチャの一貫性」を評価する能力に優れているという特性があります。

最終的に、構造的欠陥(デラミネーション、反り):

単一画像からの検出が最も困難なカテゴリです。デラミネーションは表面下の欠陥であり、正面からの撮影では捉えられない場合があります。対策としては、複数角度からの撮影(俯瞰+側面45度)や、構造光(Structured Light)による3Dスキャンの導入が考えられます。ただし、後者はコストが大幅に上がるため、コンシューマ用途では「側面撮影の追加」が現実的な落としどころです。

ISO/ASTM 52902:2023と標準化ギャップ

現在、積層造形の品質に関する国際規格として、ISO/ASTM 52902:2023(Additive manufacturing — Test artefacts — Geometric capability assessment of additive manufacturing systems)が存在します。この規格は、幾何学的ベンチマーク試験片の設計と評価方法を定義しています。

しかし注意すべきは、ISO/ASTM 52902:2023はあくまで「幾何学的能力の評価」を対象としており、AIベースの視覚検査に関する国際規格は2026年時点で存在しないという事実です。これは標準化ギャップ(standardization gap)であり、検査基準の統一が進んでいないことを意味します。

実務上の示唆は明確です。自社(または自分)の検査基準を、再現可能な形で定義する必要があります。前述の7カテゴリ分類と、各カテゴリのconfidence閾値を文書化し、バージョン管理することが、事実上の「社内標準」として機能します。

プリントファーム統合:OctoPrint × 検査エージェントの連携アーキテクチャ

OctoPrint Event Systemの活用

具体的には、OctoPrintは、印刷プロセスの各段階でイベントを発火するアーキテクチャを持っています。AI外観検査 3Dプリントのシステムをプリントファームに統合する鍵は、PrintDoneイベントのフックです。

# OctoPrint Plugin: PostProcessInspectorPlugin

class PostProcessInspectorPlugin:

"""

OctoPrintプラグインとして検査エージェントを統合。

PrintDoneイベントを監視し、自動検査を起動する。

"""

def on_event(self, event: str, payload: dict):

if event == "PrintDone":

job_name = payload.get("name", "unknown")

printer_id = self._get_printer_id()

# 冷却待ち後に検査を起動

result = self.inspector.run_inspection()

# 結果をMQTTで配信

self._publish_mqtt(

topic=f"farm/{printer_id}/inspection",

payload={

"job": job_name,

"timestamp": self._now_iso(),

"result": result

}

)

# FAIL判定の場合はアラート送信

if result["verdict"] == "FAIL":

self._send_alert(

printer_id, job_name, result

)既存エコシステムとの共存設計

つまり、この設計の核心は、既存のOctoPrintエコシステムに「印刷後」のフェーズを追加しているだけであり、印刷中の監視(Obico等)と完全に共存できる点です。印刷中はObicoがスパゲッティ化を監視し、印刷が正常完了した後に検査エージェントが品質判定を実行する。二段構えの品質保証体制が構築されます。

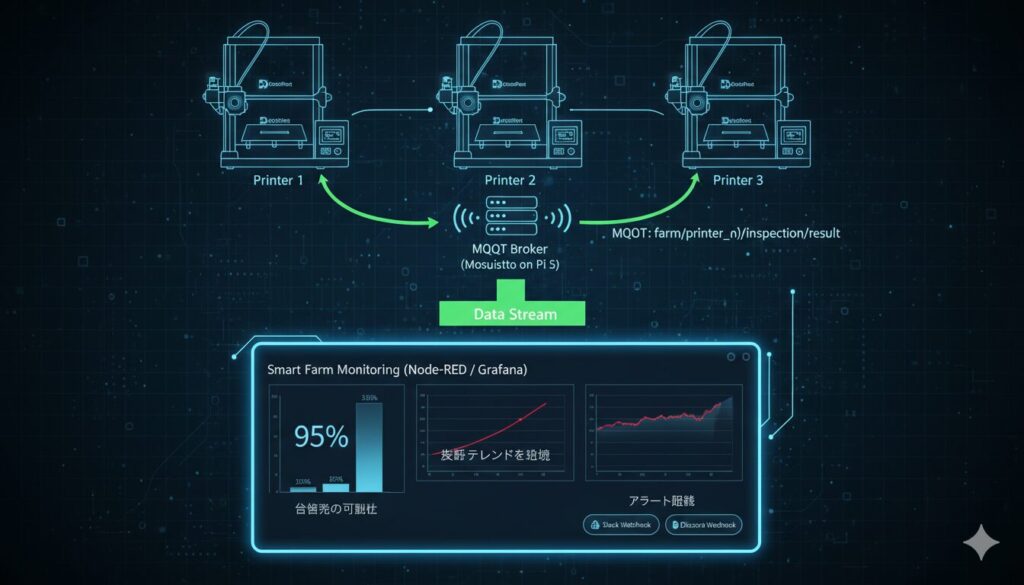

MQTTベースのファーム統合アーキテクチャ

さらに、プリントファーム環境では、複数のプリンターから検査結果を一元管理する必要があります。MQTTプロトコルによるPub/Sub型の通信が、この要件に最も適しています。

各プリンターに搭載されたRaspberry Pi(またはプリンター共有のPi 5 1台)が検査を実行し、結果をMQTTブローカーに送信します。ダッシュボードでは、プリンターごとの合格率、欠陥タイプの頻度分布、時系列のトレンドを可視化できます。

たとえば、「Printer 2のストリンギング検出率が先週から30%増加している」というトレンドが可視化されれば、リトラクション設定の見直しやノズルの摩耗確認という予防保全アクションに直結します。これは目視検査では得られない、データ駆動型の品質管理です。

既存プラグインとの使い分け

既存のOctoPrintプラグインとの関係を明確に整理しておきます。

| プラグイン/ツール | 対象フェーズ | 検出対象 | 本検査システムとの関係 |

|---|---|---|---|

| Obico | 印刷中 | スパゲッティ化、造形崩壊 | 完全に補完的。印刷中はObicoが監視 |

| PrintWatch | 印刷中 | 各種欠陥 | 補完的。ベッドチェックはベータ版 |

| BedCheckAI | 印刷前 | ベッドの空き確認 | 前工程。検査とは無関係 |

| PiNozCam | 印刷中 | Pi ARM CPUでローカル推論 | 印刷中監視。印刷後は非対応 |

| 本システム | 印刷後 | 7カテゴリの欠陥品質判定 | 既存エコシステムの空白を埋める |

この表が示す通り、印刷後の品質検査は既存エコシステムにおいて明確に欠けている機能です。本システムは既存ツールを置き換えるのではなく、パイプラインの最終段階に「品質ゲート」を追加するものです。

まとめ:品質管理の「自動化」が3Dプリントを製造業に変える

3Dプリントが「趣味」から「製造業」に昇格するために、足りないものは何か。プリンターの速度でも、材料の強度でも、ソフトウェアの機能でもありません。品質保証の仕組みです。

3つの技術的根拠

本記事で解説したAI外観検査 3Dプリントのアプローチは、以下の3つの事実に基づいています。

目視検査は構造的に不十分である。 再現性70〜85%、微細欠陥の見落とし、スケール不可能。これは検査員の能力の問題ではなく、人間の視覚システムの物理的限界です。

コンピュータビジョンは実用段階に到達した。 YOLOv11mのprecision 91.28%、改良YOLOv8のmAP50 97.5%、ViTのaccuracy 95.98%。これらの数値は、人間の目視検査を凌駕する水準です。さらに、3D-ADAMのような大規模データセットの登場により、モデル訓練のボトルネックも解消されつつあります。

印刷後検査は明確なオープンギャップである。 Obico、PrintWatch、Bambu Lab内蔵カメラ、SimplyPrint。いずれも印刷中の監視に特化しており、印刷後の品質判定を自動化するソリューションは事実上存在しません。

150ドルで始める品質革命

Raspberry Pi 5(約80ドル)、USBカメラ(約30ドル)、リングライト(約15ドル)。合計150ドル程度の投資で、プリントファームに「品質管理部門」を追加できます。NCNNランタイム上のYOLOv8nは、CPU-onlyで約10〜12 FPSの処理能力を発揮し、印刷後検査には十分すぎる速度です。将来的にHailo-8L AI Kit(約70ドル)を追加すれば、136.7 FPSという桁違いの推論速度が得られ、コンベアベルト上を流れるパーツの連続検査にも対応可能です。

失敗プリントの死で論じた「AIによる失敗の排除」は、印刷中のリアルタイム監視として既に実用化されています。24時間プリンターを監視するAIエージェントが印刷中の異常を検出し、本記事のシステムが印刷後の品質を判定する。この二段構えの品質保証体制こそが、プリントファームを「無人工場」に変える鍵です。

標準化ギャップと今後の展望

さらに、ISO/ASTM 52902:2023が幾何学的能力評価の枠組みを提供しているとはいえ、AIベースの視覚検査に対応した国際規格は未整備です。この標準化ギャップは、逆に言えば早期参入者にとってのチャンスでもあります。自社の検査基準を先行的に策定し、データを蓄積することが、将来の規格策定においても競争優位になりうるのです。

結論として、目視検査を卒業するタイミングは、今です。あなたのプリンターが出力したパーツの品質を、あなた自身の目ではなく、再現可能な数値として記録する。そこから、3Dプリントは「モノを作る趣味」から「品質が保証された製造業」へと変貌します。