製造現場×AI×3Dプリンター:セキュリティと自動品質管理の最前線【2026年版】

2026年、製造業における3Dプリンターの活用が急拡大しています。世界の産業用3Dプリンティング市場は2025年に約430億ドル規模(2025年推定)に達し、2035年には738億ドルへ成長すると予測されています(年平均成長率15.1%)。BMWグループは年間100万個の3Dプリント部品を生産し、ボーイングは15万点以上の3Dプリント部品をポートフォリオ全体に組み込んでいます。

しかし、この急成長の裏側では2つの深刻な課題が浮上しています。ひとつは企業の機密データを守るセキュリティ、もうひとつは製造品質を保証する自動品質管理です。本記事では、Bambu Lab X1Eが示す「エンタープライズセキュリティ」の解決策と、AIが実現する「リアルタイム品質管理」の革新を、最新データとともに解説します。

企業が3Dプリンターを導入できない「セキュリティの壁」

多くのモダンな3Dプリンターは、スライスデータや監視カメラの映像をクラウド経由で処理しています。ホビーユースなら問題ありませんが、未発表のプロトタイプデータが社外のサーバーに保存されるとなると話は別です。実際、3D Systems社は2012年から2019年にかけてITAR規制に違反し、設計データを無許可で海外に転送したとして、最大2,700万ドルの制裁金を科されました。

製造業で3Dプリンターの導入を阻む主要なセキュリティ課題は3つあります。

- 知的財産の流出リスク:3Dプリント用のデジタル設計ファイルは「作成は簡単、コピーも簡単、保護は極めて困難」と言われています。動画ベースの攻撃では、ノズルの動きを追跡するだけでGコードを逆算できることも研究で示されています

- ネットワーク接続の脆弱性:クラウド連携が前提の機種では、802.1X認証などのエンタープライズネットワーク標準に対応しておらず、IT部門の承認が得られないケースが多発しています

- コンプライアンス要件:防衛産業ではITAR(国際武器取引規則)、連邦政府契約ではNIST 800-171やCMMC 2.0への準拠が求められます。これらの認証を取得していないプリンターは、そもそも導入候補に入りません

Bambu Lab X1E:エンタープライズセキュリティの解答

Bambu Lab X1Eは、2,499ドルという価格帯で「高速なコンシューマー機の利便性」と「エンタープライズの厳格なセキュリティ」を融合させたマシンです。

LAN専用モードによる完全オフライン運用

X1Eの最大の特徴は「LAN専用モード」です。このモードでは、プリンターはBambu Labのクラウドサーバーと一切通信しません。社内ネットワーク内だけで完結するため、機密データがファイアウォールを越えることは物理的にあり得ません。さらにWi-Fiモジュールは物理的に取り外し可能で、イーサネットポートも物理キルスイッチを搭載しています。

802.1X認証とエンタープライズネットワーク対応

X1Eは802.1X(WPA2-Enterprise)ネットワーク認証に対応しており、EAP-PEAP、EAP-TLS、EAP-TTLSの各方式をサポートします。これにより、企業のセキュリティポリシーに準拠した形でネットワーク接続が可能です。IT部門が管理する認証基盤にプリンターを統合でき、アクセス制御を一元管理できます。

エンジニアリンググレードの造形性能

セキュリティだけでなく、造形性能も産業用途に対応しています。最大320度のノズル温度とアクティブ加熱チャンバー(最大60度)により、PA-CF(カーボンファイバー入りナイロン)、PC(ポリカーボネート)、PPS-CFなどのスーパーエンジニアリングプラスチックを安定して造形できます。HEPA H12フィルターと活性炭フィルターによる重層的なエアフィルトレーションも、工場環境での運用を想定した設計です。

競合他社のエンタープライズセキュリティ対応

- Stratasys(ProtectAM):Red Hat Enterprise Linuxベースのデータセキュリティ基盤を提供。CMMC 2.0 Level 2(110のセキュリティ要件)、NIST 800-171、DFARS 252.204-7012に準拠。GrabCADによるロールベースアクセス制御と多要素認証を搭載

- UltiMaker(Secure Line):2025年に発表されたS6 SecureとS8 Secureモデル。防衛IT基準に準拠した堅牢化設計で、スパイ行為やリモート侵入からの保護機能を搭載。TLS 1.2 HTTPS暗号化(2048ビットRSA)でクラウド通信を保護

- Markforged:ISO/IEC 27001認証を取得済み。Eiger Cloudによるフリート管理に加え、Offline Eigerでファイアウォール内のオンプレミス運用にも対応。制限されたインターネット環境向けにUSBやプライベートLAN接続をサポート

AIによるリアルタイム品質管理の革新

Invisible AI:製造現場のコンピュータビジョン

Invisible AIは、製造現場向けのコンピュータビジョンと動作解析に特化したAI企業です。シリーズAラウンドで1,500万ドル(累計2,100万ドル)を調達し、トヨタ自動車北米法人(TMNA)をはじめとする大手メーカーに採用されています。

同社のエッジAIデバイスは、Intel RealSense 3DカメラとNVIDIA AIチップセットを搭載し、クラウドを介さずにオンデバイスで映像解析を処理します。最大4TBのSSDを内蔵し、3か月分のビデオデータをローカルに保存できます。トヨタ・インディアナ工場では500台のエッジデバイスが導入され、組立ラインのリアルタイム監視と品質検査を自動化しています。

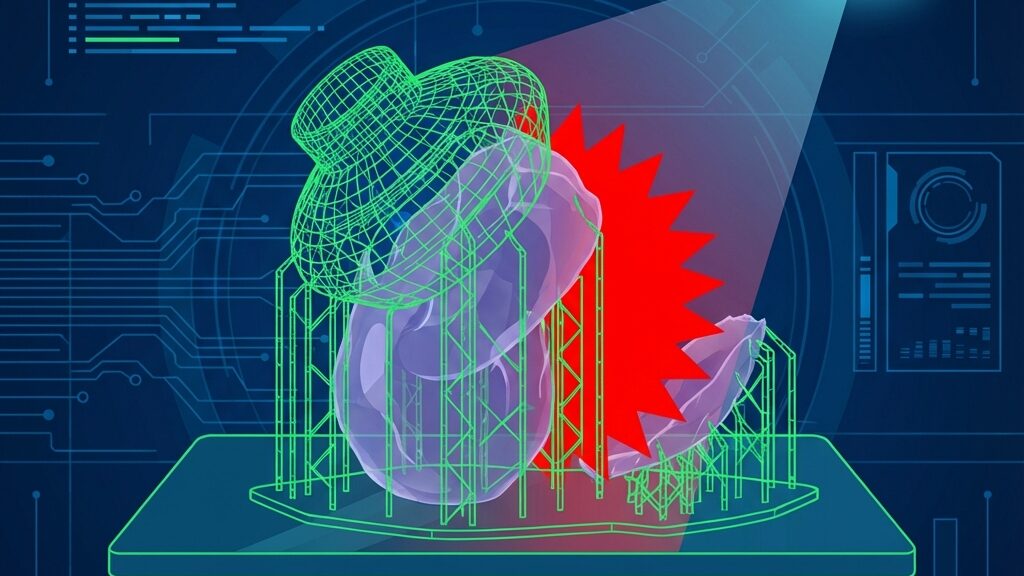

3Dプリンティングにおける閉ループ品質制御

3Dプリンティングの品質管理でもAIの活用が急速に進んでいます。AI増強アディティブマニュファクチャリング(AI2AM)は、造形プロセスの監視、パラメータの自動最適化、欠陥の自動検出を統合するアプローチです。

最新の研究では、CNNベースの欠陥検出が99%以上の精度を達成しています。具体的には、ストリンギング検出で99.31%、反り検出で99.43%の精度が報告されています。検出可能な欠陥は、過剰押出・不足押出、ストリンギング、反り、クラッキング、レイヤーシフト、スパゲッティ(造形失敗による素材の絡まり)など多岐にわたります。

自己修復型3Dプリンターの登場

2025年以降、AIによるリアルタイムの欠陥検出だけでなく、自動修正まで行う「自己修復型」3Dプリンターの研究が進んでいます。大規模言語モデル(LLM)を活用したモジュラーフレームワークでは、事前学習なしでリアルタイムの欠陥検出と修正を実現しています。

このシステムは、各レイヤーの造形完了後にビジョンシステムが画像を撮影し、ビジョン言語モデルが欠陥を分析、プランナーエージェントがプリンターの状態(温度、材料フロー率など)を評価し、エグゼキューターエージェントが修正コマンドを生成するという多段階プロセスで動作します。実験では、構造的完全性が数倍レベル向上したという結果が報告されています。

BMWとボーイングの大規模導入事例

BMWグループ:年間100万個の3Dプリント部品

BMWグループは2025年4月にミュンヘンにアディティブマニュファクチャリングキャンパスを開設しました。投資額2,500万ドル、50台の産業用3Dプリンターを備えた施設です。グループ全体では年間100万個以上の3Dプリント部品を製造し、毎日4,000個の3Dプリント砂型コアを生産しています。電動モーター用ウォータージャケットコアなど、複雑な形状の部品生産に3Dプリンティングを活用しています。

ボーイング:15万点以上の3Dプリント部品を統合

ボーイングは世界20か所の製造拠点で3Dプリンティングを活用し、ポートフォリオ全体に15万点以上の部品を組み込んでいます。2025年には3Dプリントによる太陽電池アレイ基板を発表し、従来の製造と比較してサイクルタイムを50%短縮、製造リードタイムを6か月圧縮することに成功しました。787 Dreamlinerでは環境制御ダクティングやエンジン部品に、777Xではチタン構造部品に3Dプリンティングを採用しています。

個人メイカーが今すぐ活用できるAI品質管理ツール

- Obico(旧The Spaghetti Detective):クラウドベースのAI監視サービスで、メーカーを問わず造形失敗を検出。10万人以上のメイカーが利用し、700万時間以上のプリントを監視、80万件以上の失敗を検出した実績があります

- QuinlyVision(3DQue):14種類の造形失敗パターンを認識し、自動修正機能も搭載。プリントファーム運用に適した高度な監視ソリューション

- Bambu Lab内蔵AI:LIDARセンサーによる初期レイヤースキャンとAIカメラによるスパゲッティ検出を標準搭載。追加費用なしでAI品質管理の恩恵を受けられます

- Gadget:機械学習によるリアルタイムプリント監視で、造形中の異常を早期に検出

セキュリティと品質管理の導入チェックリスト

企業導入向け:セキュリティ対策5項目

- プリンターのLAN専用モードまたはオフラインモードの有効化を確認

- 802.1Xなどのエンタープライズ認証への対応状況を検証

- 設計ファイルの暗号化とアクセス制御の仕組みを構築

- ITAR、NIST 800-171、ISO 27001などの該当するコンプライアンス要件を特定

- 物理的なアクセス制御(施錠された部屋、入退室管理、監視カメラ)を整備

品質管理の自動化:導入3ステップ

- ステップ1:AI監視ツールの選定 Obico(無料プランあり)やBambu Lab内蔵AIなど、既存プリンターに導入可能なツールから始めましょう。造形失敗の検出と通知だけでも大きな時間とコストの節約になります

- ステップ2:データ蓄積と分析 造形結果のログを記録し、どのような条件で失敗が発生しやすいかのパターンを把握します。このデータが将来のAI最適化の基盤になります

- ステップ3:閉ループ制御への移行 AI監視の信頼性が確認できたら、パラメータの自動調整(閉ループ制御)への移行を検討します。現時点では研究段階の技術ですが、商用化の波は確実に近づいています

今後の展望:デジタルツインとの融合

製造現場のセキュリティとAI品質管理は、今後デジタルツイン技術との統合が加速すると予測されています。物理的なプリンターの状態をリアルタイムでデジタル空間に再現し、異常検知や予知保全をAIが自動で行う仕組みが実用化段階に入りつつあります。

具体的には、造形中の温度分布や振動データをセンサーで取得し、デジタルツイン上でシミュレーションを実行することで、不良品が発生する前にパラメータを自動調整できます。これにより、従来は事後対応だった品質管理が予防型へと進化します。

また、ブロックチェーン技術を活用したデータの改ざん防止も注目されています。造形データの完全なトレーサビリティを確保することで、航空宇宙や医療分野で求められる厳格な品質証明にも対応可能です。セキュリティと品質管理の両面で、製造業のデジタル変革はさらに加速していくでしょう。

個人メイカーが今すぐ活用できるAI品質管理ツール

- Obico(旧The Spaghetti Detective):クラウドベースのAI監視サービスで、メーカーを問わず造形失敗を検出。10万人以上のメイカーが利用し、700万時間以上のプリントを監視、80万件以上の失敗を検出した実績があります

- QuinlyVision(3DQue):14種類の造形失敗パターンを認識し、自動修正機能も搭載。プリントファーム運用に適した高度な監視ソリューション

- Bambu Lab内蔵AI:LIDARセンサーによる初期レイヤースキャンとAIカメラによるスパゲッティ検出を標準搭載。追加費用なしでAI品質管理の恩恵を受けられます

- Gadget:機械学習によるリアルタイムプリント監視で、造形中の異常を早期に検出

セキュリティと品質管理の導入チェックリスト

企業導入向け:セキュリティ対策5項目

- プリンターのLAN専用モードまたはオフラインモードの有効化を確認

- 802.1Xなどのエンタープライズ認証への対応状況を検証

- 設計ファイルの暗号化とアクセス制御の仕組みを構築

- ITAR、NIST 800-171、ISO 27001などの該当するコンプライアンス要件を特定

- 物理的なアクセス制御(施錠された部屋、入退室管理、監視カメラ)を整備

品質管理の自動化:導入3ステップ

- ステップ1:AI監視ツールの選定 Obico(無料プランあり)やBambu Lab内蔵AIなど、既存プリンターに導入可能なツールから始めましょう。造形失敗の検出と通知だけでも大きな時間とコストの節約になります

- ステップ2:データ蓄積と分析 造形結果のログを記録し、どのような条件で失敗が発生しやすいかのパターンを把握します。このデータが将来のAI最適化の基盤になります

- ステップ3:閉ループ制御への移行 AI監視の信頼性が確認できたら、パラメータの自動調整(閉ループ制御)への移行を検討します。現時点では研究段階の技術ですが、商用化の波は確実に近づいています

Q8. デジタルツインは中小企業でも導入できますか?

クラウドベースのデジタルツインサービスが登場しており、初期投資を抑えた導入が可能になりつつあります。まずはセンサーデータの収集から始め、段階的にAI解析機能を追加していく方法が現実的です。月額数万円から利用できるサービスも出始めています。

個人メイカーが今すぐ活用できるAI品質管理ツール

- Obico(旧The Spaghetti Detective):クラウドベースのAI監視サービスで、メーカーを問わず造形失敗を検出。10万人以上のメイカーが利用し、700万時間以上のプリントを監視、80万件以上の失敗を検出した実績があります

- QuinlyVision(3DQue):14種類の造形失敗パターンを認識し、自動修正機能も搭載。プリントファーム運用に適した高度な監視ソリューション

- Bambu Lab内蔵AI:LIDARセンサーによる初期レイヤースキャンとAIカメラによるスパゲッティ検出を標準搭載。追加費用なしでAI品質管理の恩恵を受けられます

- Gadget:機械学習によるリアルタイムプリント監視で、造形中の異常を早期に検出

セキュリティと品質管理の導入チェックリスト

企業導入向け:セキュリティ対策5項目

- プリンターのLAN専用モードまたはオフラインモードの有効化を確認

- 802.1Xなどのエンタープライズ認証への対応状況を検証

- 設計ファイルの暗号化とアクセス制御の仕組みを構築

- ITAR、NIST 800-171、ISO 27001などの該当するコンプライアンス要件を特定

- 物理的なアクセス制御(施錠された部屋、入退室管理、監視カメラ)を整備

品質管理の自動化:導入3ステップ

- ステップ1:AI監視ツールの選定 Obico(無料プランあり)やBambu Lab内蔵AIなど、既存プリンターに導入可能なツールから始めましょう。造形失敗の検出と通知だけでも大きな時間とコストの節約になります

- ステップ2:データ蓄積と分析 造形結果のログを記録し、どのような条件で失敗が発生しやすいかのパターンを把握します。このデータが将来のAI最適化の基盤になります

- ステップ3:閉ループ制御への移行 AI監視の信頼性が確認できたら、パラメータの自動調整(閉ループ制御)への移行を検討します。現時点では研究段階の技術ですが、商用化の波は確実に近づいています

よくある質問(FAQ)

Q1. Bambu Lab X1Eは個人でも購入できますか?

はい、2,499ドル(約37万円)で個人でも購入可能です。ただし、LAN専用モードやエンタープライズ認証機能は企業向けに設計されており、ホビーユースにはX1 Carbonの方がコストパフォーマンスに優れます。

Q2. AI品質管理は小規模な3Dプリントでも効果がありますか?

効果があります。ObicoのようなAI監視ツールは、月に数回のプリントでも無人運転時の安心感を大幅に高めます。夜間や外出中のプリントで造形失敗による材料の無駄や火災リスクを低減できます。

Q3. 閉ループ品質制御はいつ頃一般ユーザーに普及しますか?

部分的な閉ループ制御(初期レイヤーのスキャンと自動調整)は、Bambu Lab機に既に搭載されています。完全な層ごとの欠陥検出と自動修正については、研究では99%以上の精度が達成されており、2〜3年以内に商用製品への統合が進むと予想されています。

Q4. 企業がITAR準拠の3Dプリンターを選ぶ際のポイントは?

ITAR準拠が求められる場合、Stratasys ProtectAMのようにCMMC 2.0 Level 2認証を取得した製品が最適です。Bambu Lab X1EのLAN専用モードも有効ですが、正式な認証は取得していないため、IT部門と連携して追加のセキュリティ対策を講じる必要があります。

Q5. Invisible AIのようなシステムは3Dプリンターにも適用できますか?

Invisible AIは組立ラインの監視に特化していますが、同様のコンピュータビジョン技術は3Dプリンティングにも応用されています。ObicoやQuinlyVisionはまさにこのアプローチで、カメラ映像からAIが造形状態を解析しています。

Q6. セキュリティ対策で最もコスパが良い方法は?

最もコスパが良いのは、既存プリンターのネットワーク設定でクラウド通信を無効化し、ローカルネットワークのみで運用することです。多くのプリンターにはローカルモードやLAN専用設定があり、追加コストなしでデータ流出リスクを大幅に低減できます。

Q7. 今後のトレンドはどうなりますか?

セキュリティ(データが外部に漏れない安心感)と品質管理(印刷が失敗しない信頼感)の2つが揃った時、3Dプリンターは試作だけでなく最終製品の製造ラインに本格的に組み込まれます。現在は製造現場の最前線にあるこれらの技術が、数年後にはすべてのデスクトッププリンターに標準搭載される流れが始まっています。

まとめ

製造業における3Dプリンターの本格導入には、セキュリティと品質管理という2つの壁を越える必要があります。Bambu Lab X1EのLAN専用モードや802.1X認証は、2,499ドルという手の届く価格でエンタープライズセキュリティを実現しました。AIによる品質管理では、99%以上の欠陥検出精度と自己修復型プリンターの研究が進み、BMWの年間100万個、ボーイングの15万点以上といった大規模導入を支えています。

個人メイカーにとっても、ObicoやBambu Lab内蔵AIのようなツールで今すぐAI品質管理の恩恵を受けられます。セキュリティと品質管理の両面で3Dプリンターが「信頼できる製造装置」へと進化する流れは、もはや止められません。

あわせて読みたい

- DeepSeek V4 vs. Claude 4.5: オープンソースの「コーディング王」は帰還するか?

- 【2026年標準】AIエージェントの”USB-C”。Model Context Protocol (MCP) 完全技術解説

- Orca Slicer 2.3.1 Alpha レビュー:これは「インフィルの再発明」だ

さらに詳しい情報はAll3DPでご覧いただけます。