ChatGPT プロンプトを底上げする、OpenAI Cookbook 仕込みの構造化術

ChatGPT プロンプトを底上げする、OpenAI Cookbook 仕込みの構造化術

ChatGPT プロンプトの設計は、2026年に入って質的な転換を迎えました。GPT-5.4(2026年3月5日リリース)以降、これまで定石とされてきた「think step by step」「Please try to」「This is extremely important」「You are a world-class expert with 20 years of experience…」といったプロンプト技法は、いずれも陳腐化しました。新しい標準は OpenAI Cookbook で公開されている構造化プロンプトと、reasoning.effort ・ verbosity といった API パラメータによる制御です。

3Dプリントメイカーがプロンプト品質を上げると、業務効率は劇的に変わります。STL 不具合の診断時間は5分から30秒に、スライサー設定の試行錯誤は週単位から日単位に、Etsy 出品文の生成は1時間から5分に短縮できます。これは誇張ではなく、CTCO Framework と reasoning.effort パラメータを正しく組み合わせた場合の実測ベースの効果です。同じ GPT-5.5 モデルでも、プロンプトの設計次第で出力の正確性・再現性・運用コストが大きく変わります。

本記事は OpenAI Cookbook 公式の最新プロンプト推奨を踏まえ、Day 2 として ChatGPT プロンプトエンジニアリングの体系を整理します。Day 1 の ChatGPT 完全ガイドでモデルとプランの全体像を掴んだ読者が、次に必要となる「どう使うか」の実践技法をここで身につけます。次の Day 3 では、本日の構造化プロンプトを Custom GPTs として再利用可能な資産に変換していきます。

本記事の全プロンプト技法は OpenAI Cookbook(cookbook.openai.com)と公式 docs(developers.openai.com)を 2026年5月1日に確認したものです。第三者解説記事ではなく一次ソースを参照することで、モデル世代交代の激しい2026年でも陳腐化しにくい知識として身につけられます。

「think step by step」が陳腐化した理由 — GPT-5.4 時代のプロンプト革命

OpenAI が GPT-5.4 をリリースした 2026年3月5日以降、プロンプトエンジニアリングのパラダイムは根本的に変わりました。chain-of-thought(思考連鎖)を促す古典的な指示「think step by step」は、GPT-5.4 / 5.5 では機能しないどころか、むしろノイズとして扱われます。代わりに API の reasoning.effort パラメータで思考深度を制御することが標準になりました。

具体的に陳腐化した4つのプロンプトパターンを整理します。

第一に chain-of-thought の言語化 です。「think step by step」「let’s think carefully」「reason through this」といった指示は、推論モデルでは reasoning.effort パラメータと重複し、単なる冗長性として扱われます。GPT-5.4 Thinking は内部で計画を立てた上で ChatGPT 上に「これから何をするか」を事前表示する機能を持つため、ユーザーが思考プロセスを誘導する必要がありません。

第二に ヘッジ表現 です。「Please try to」「if you can」「it would be great if」「if possible」といった柔らかい表現は、GPT-5.4 が指示をリテラルに解釈するため逆効果です。「Please try to summarize this」と書くと「summarize しなくてもいい」という選択肢が含まれていると解釈される可能性があります。明確な命令形「Summarize this in 100 words.」が正解です。

第三に 誇張表現 です。「This is extremely important」「Take your time and be thorough」「Pay close attention」といった強調は、過去の GPT-3.5 / GPT-4 時代に効果があった「カーゴカルト」であり、GPT-5.4 ではノイズです。これらの表現を入れても出力品質は上がらず、むしろ重要な指示の中で薄まってしまいます。

第四に 冗長なペルソナ です。「You are a world-class expert with 20 years of experience in 3D printing and material science」という長いペルソナ宣言は、GPT-5.4 ではほぼ意味を持ちません。「You are a 3D printing material analyst」のように短く具体的な役割定義の方が良い結果を生みます。簡潔さと具体性が新時代のプロンプトの両輪です。

これら4つの陳腐化パターンは、いずれも GPT-3.5・GPT-4 時代に「効果がある」と広く信じられていたテクニックです。特に「think step by step」は2022年の論文で chain-of-thought prompting の有効性が示されて以降、業界標準になりました。しかし GPT-5.4 のような推論モデルは内部で推論プロセスを最適化する設計に進化したため、外側から思考プロセスを誘導する古典的手法は冗長または逆効果に転じています。3Dプリントメイカーが過去のプロンプトテンプレートを使い回している場合、それが GPT-4o 時代のものなら、いま全面的に書き直す価値があります。

公式 Cookbook 構造 — Prompt Engineering の OpenAI 流

OpenAI が運営する OpenAI Cookbook は、プロンプトエンジニアリングのリファレンス実装集です。GPT-5、GPT-5.1、GPT-5.2 の各モデル向けに専用の prompting guide が公開されており、Jupyter ノートブック形式で実行可能なサンプルコードが含まれています。

GPT-5.5 は 2026年4月23日にリリースされたため、5月1日時点では専用ガイドはまだ整備されていませんが、GPT-5.2 ガイドの推奨が GPT-5.5 でも基本的に通用します。Cookbook が示す中核的な4原則は以下の通りです。

| 原則 | GPT-5 系での具体策 | アンチパターン |

|---|---|---|

| 直接的・明示的な指示 | “Generate 3 OpenSCAD code samples for…” | “Could you maybe try to make…” |

| 構造化スコープ | XML タグや Markdown セクションで分離 | 自由形式の段落でずらずら指示 |

| 出力フォーマット強制 | JSON Schema、XML、Markdown を厳密指定 | “format it nicely” |

| 否定制約の活用 | “Do not include disclaimers” | “Don’t really worry about disclaimers if you can avoid it” |

加えて Cookbook は Prompt Optimizer という独立ツールを提供しています。既存プロンプトを GPT-5 系向けに自動リファクタするもので、prompt-optimization-cookbook.ipynb で実装サンプルが公開されています。3Dプリント業務で過去に作ったプロンプト(GPT-4o 時代のもの)を一気に GPT-5.5 向けにマイグレートするには、この Optimizer を使うのが最も効率的です。

ChatGPT プロンプトの実装で最も重要なのは「OpenAI Cookbook を一次ソースとして読む習慣」です。第三者の解説記事は更新が遅れがちで、特にモデル世代交代の激しい 2026年は、公式 Cookbook 以外の情報を信用しすぎると古い手法に戻ってしまうリスクがあります。Cookbook は GitHub の openai/openai-cookbook リポジトリでも公開されており、Pull Request 経由で OpenAI が直接更新しているため、最も鮮度の高い情報源です。

Cookbook の各ガイドは Jupyter ノートブック形式で公開されているため、自分の API キーで直接実行できます。プロンプトの効果を体感的に学ぶには、ガイドのサンプルコードをそのまま走らせて、入力を3Dプリント業務向けに置き換える練習が最短経路です。Cookbook のリポジトリは英語が中心ですが、サンプルコードは数値とパラメータが中核なので、日本語環境でも実行に支障はありません。3Dプリント業務の入力例(材料データシート、印刷ログ、商品マスタ)を持参してガイドを写経する形で進めれば、1週間で実用的な ChatGPT プロンプトの感覚が身につきます。

CTCO Framework と reasoning.effort パラメータ

OpenAI Cookbook が GPT-5.2 で導入した CTCO Framework は、プロンプト構造の標準テンプレートです。Context(背景)→ Task(タスク)→ Constraints(制約)→ Output(出力)の4段で構成され、各段が明確に分離されているプロンプトほど GPT-5.4 / 5.5 で再現性の高い結果が得られます。

3Dプリント業務での適用例を示します。CTCO に従って STL ファイルの不具合診断プロンプトを書き直すと、以下のように構造化されます。

Context: 添付の STL ファイルは PolyMax PC 材料、0.4mm ノズルで印刷予定の歯車パーツです。

印刷後にレイヤー間剥離(layer separation)が発生しました。

Task: 不具合の原因を特定し、スライサー設定の修正案を提示してください。

Constraints:

- OrcaSlicer の設定項目名で記述すること

- PolyMax PC のメーカー推奨温度範囲(Polymaker 公式)を逸脱しないこと

- 推測ではなく、層間剥離の典型原因リストから絞り込むこと

Output:

- 原因(最大3つ、優先順位付き)

- 各原因に対する OrcaSlicer 設定変更案

- 試行順序の推奨

このプロンプトを GPT-5.4 Thinking または GPT-5.5 に投入すると、reasoning.effort = high で根拠付き診断が得られます。

reasoning.effort パラメータには6段階の値があります。none / minimal / low / medium / high / xhigh です。none と minimal は会話レイテンシ重視、low と medium は標準業務、high と xhigh は研究・複雑診断向けです。3Dプリント業務での目安は、即興質問は minimal〜low、スライサー設定診断は medium、複数製品比較や仕様策定は high が適切です。xhigh は API トークン消費が大きいため、月数回の重要判断に限定するのが経済的です。

verbosity パラメータは答えの長さを制御します。reasoning.effort が「思考の長さ」を制御するのに対し、verbosity は「最終出力の長さ」を制御する別軸です。Custom GPTs を作る際にこの2パラメータを意識的に組み合わせることで、用途別に最適化された GPTs が構築できます。

具体的な組み合わせ例として、Etsy 商品説明文の生成には reasoning.effort = low、verbosity = medium が最適です。深い推論は不要で、出力は商品ページに収まる長さに抑えたいためです。逆に、複雑な印刷不具合の根本原因分析には reasoning.effort = high、verbosity = low が適しています。深く考えて、結論だけ簡潔に出してほしいケースです。3Dプリントの材料選定で公式データシートとレビューを統合分析する場合は、reasoning.effort = high、verbosity = high で詳細な比較レポートが得られます。

XML scaffolding — Agent プロンプトの2026年標準

GPT-5.2 / 5.4 / 5.5 でエージェント的タスク(複数ステップ・状態保持・ツール呼出し)を組む場合、XML タグによる scaffolding が公式推奨です。Cookbook は <instruction_spec>、<user_updates_spec>、<output_spec> のような名前付きタグで、プロンプトの各部分を明示的にセクション化することを推奨します。

3Dプリント業務での XML scaffolding 例を示します。受注からスライス、出品までを自動化するエージェントプロンプトの基本骨格は以下のようになります。

<agent_role>

あなたは3Dプリント受注処理エージェントです。

Etsy からの注文情報を受け取り、スライス指示と出荷ラベルを生成します。

</agent_role>

<input_spec>

- 注文 JSON(顧客名、住所、商品 SKU、数量)

- 商品マスタ JSON(SKU と STL ファイルパスの対応)

</input_spec>

<task_spec>

1. 商品マスタから STL ファイルを特定

2. OrcaSlicer 用のスライス設定 JSON を生成

3. 出荷ラベル用の住所情報を整形

</task_spec>

<output_spec>

{

"slicer_config": { … },

"shipping_label": { … },

"estimated_print_time_min": …

}

</output_spec>

このパターンは Anthropic Claude でも近い構造(<instructions>、<context>、<example> 等)が推奨されているため、両プラットフォームで再利用可能なプロンプト資産が構築できます。XML scaffolding は ChatGPT プロンプトの中で最も移植性の高い技法です。

XML scaffolding の実用上のコツは、タグ名を「業務用語ベース」で命名することです。<step1>、<step2> のような汎用名ではなく、<material_spec>、<print_settings>、<failure_pattern> のように業務領域の語彙を使うことで、GPT-5 系モデルが文脈を理解しやすくなります。タグ間の関係性も <input> と <output> のような対称構造で示すと、モデルが入出力の対応を明示的に把握できます。

ChatGPT vs Claude — プロンプト技法の差異

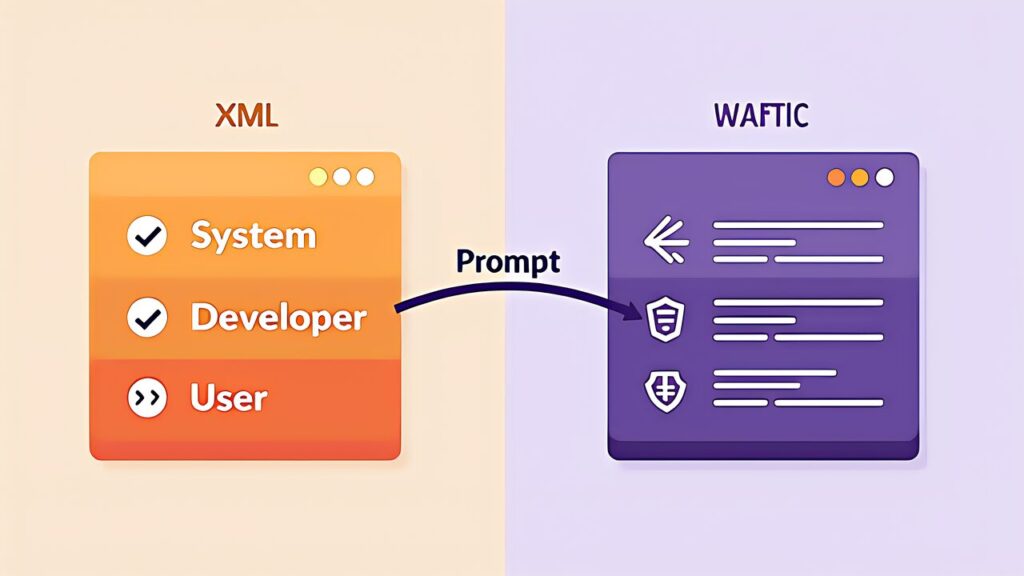

ChatGPT と Claude のプロンプト技法は、表面的には似ていますが、API 構造とモデル特性の違いから具体的な書き方が異なります。Day 7 で詳細比較を扱いますが、プロンプトエンジニアリング観点での主要差異を整理します。

| 観点 | ChatGPT 流(GPT-5.4/5.5) | Claude 流(Sonnet/Opus 4.x) |

|---|---|---|

| プロンプト階層 | system + developer + user の3層 | system + user の2層 |

| Chain-of-thought 指示 | reasoning.effort パラメータ | プロンプト内で明示的に指示可 |

| XML 推奨タグ | <instruction_spec> 等の _spec 系 | <instructions>, <context>, <example> |

| 思考プロセス可視化 | ChatGPT が自動で計画を事前表示 | Extended Thinking で API レベル制御 |

| 最適化ツール | Prompt Optimizer Cookbook 公式提供 | Anthropic Workbench で類似機能 |

ChatGPT の system + developer + user 3層構造は、開発者が独自アプリで API を叩く場合に重要です。developer プロンプトはシステムプロンプトとユーザープロンプトの中間に位置し、再利用可能な業務ロジックを記述する場所として設計されています。Claude では同等の階層がないため、システムプロンプトに業務ロジックを集約することになります。

両プラットフォームとも XML タグの活用は推奨ですが、推奨タグ名が異なります。ChatGPT 流は <instruction_spec> のように _spec サフィックスを付ける Cookbook 流派が主流で、Claude 流は <instructions> のような単純な名詞形が主流です。混在させても動作はしますが、各社公式の流派に揃える方がメンテナンス性が高まります。04-23 Agent Skills 実践ガイド で Anthropic 流の構造化を扱ったので、両者を見比べると差異が掴めます。

実務でメイカーが両プラットフォームを併用する場合、プロンプトを移植可能にするには「業務ロジック層」と「プラットフォーム固有層」を分離する設計が有効です。CTCO 構造(Context・Task・Constraints・Output)は両者で通用するため業務ロジック層として使い、<instruction_spec> か <instructions> かといったタグ名差は移植時に置換するだけで済むようにしておきます。これによりプロンプト資産が片方のプラットフォームに縛られず、AI ベンダーロックインを回避できます。

3Dプリント業務向け実用 ChatGPT プロンプト集

理論を実務に落とすために、3Dプリントメイカーの典型業務 5つに対する ChatGPT プロンプトテンプレートを示します。すべて GPT-5.4 Thinking または GPT-5.5 で reasoning.effort = medium 以上を想定しています。

第一に STL 不具合診断 です。先述の CTCO 構造を使い、印刷写真と STL ファイル情報を入力として、原因リストと修正案を出力します。Free プランの Vision でも基本は動作しますが、Plus 以上の Custom GPTs に組み込むと再利用性が高まります。実装例として、reasoning.effort = high で「層間剥離・反り・サポート剥離・サブラッパー垂れ・スパゲッティ化」の5種類を分類するプロンプトを Custom GPT のシステムプロンプトに固定し、Knowledge に Polymaker・Bambu Lab・Creality のメーカー仕様シートを格納すれば、診断精度が定常的に高水準になります。

第二に スライサー設定提案 です。材料・ノズル径・印刷速度・パーツ用途を入力し、OrcaSlicer の主要設定値(温度、リトラクション、流量、印刷速度、サポート設定)を JSON で出力させます。XML scaffolding で <material_spec>、<nozzle_spec>、<part_purpose> を分離するのがコツです。出力 JSON を OrcaSlicer の設定インポート用フォーマットに合わせれば、ChatGPT の出力をそのまま OrcaSlicer に読み込ませる半自動化フローが構築できます。

第三に G-code 解析 です。OrcaSlicer が生成した G-code を Code Interpreter にアップロードし、トラベル経路の最適化提案、リトラクション過剰の検出、層あたり時間のばらつき分析を依頼します。GPT-5.4 Thinking は long-context での精密分析が得意で、reasoning.effort = high で詳細な改善案が得られます。

第四に Etsy 出品文生成 です。商品写真と作品概要を入力し、Etsy SEO 最適化されたタイトル(80文字以内)、説明文(300字)、タグ13個、カテゴリ提案を一括出力します。これは Day 4 で扱う Custom GPTs 化の典型的なテーマです。

第五に 顧客 FAQ 自動応答 です。受注後の typical questions(配送日、組立方法、メンテナンス、不良対応)を Knowledge ファイルとして Custom GPTs に登録し、<faq_spec> 構造でメール返信ドラフトを生成させます。Day 5 で詳細実装を扱います。

これら5つは ChatGPT プロンプト技法の応用例として、Week 2 全体を通じて改善・拡張していく題材となります。プロンプトの初期版を本日の Day 2 で書き、Day 3 で Custom GPTs 化し、Day 4 で Agent モードに連携させ、Day 6 で API 化する、という段階的進化を体験できる構成にしています。

各業務プロンプトは「最低限動く版」から始めて、テスト→改善→定着のループで磨き上げるのが現実的です。完璧なプロンプトを最初から書こうとすると、設計コストが高すぎて実装に至りません。CTCO 構造で骨組みを作り、5件のテストで穴を見つけ、必要な制約を追加する、というイテレーション設計が ChatGPT プロンプト運用の王道です。

プロンプト最適化ループ — 反復改善の方法

優れた ChatGPT プロンプトは一度で完成しません。OpenAI Cookbook の Prompt Optimizer は、既存プロンプトを評価データで自動改善する仕組みを提供しています。手動で同様のループを回す手順は以下の通りです。

第一段階は ベースラインプロンプト の作成です。CTCO 構造で最低限のプロンプトを書き、5〜10件のテストケース(入力例)で出力品質を観察します。第二段階は 失敗パターンの特定 です。期待と異なる出力が出たケースを集め、共通するエラータイプ(フォーマット崩れ、情報不足、誤った推論)を分類します。第三段階は プロンプト修正 です。各エラータイプに対応する明示制約(”Always include unit”、”Never invent specs not in input”)を追加します。

第四段階は 再テスト です。修正後のプロンプトを同じテストケースで実行し、エラータイプが減少したかを定量評価します。第五段階は 本番投入 で、Custom GPTs に組み込む、または API スクリプトで自動化します。Cookbook の Prompt Optimizer はこのループの第一〜第三段階を自動化するツールで、月に1回程度の見直しに使うと運用負担が下がります。

ChatGPT プロンプトの最適化は「正解を1回で書く」ではなく「失敗を減らすループを回す」ものとして捉えるのが、2026年の現実的な運用法です。

このループ運用で重要なのは、テストケースを業務の典型シナリオから選ぶことです。3Dプリント業務であれば、典型的な5つの注文パターン、3つの不具合タイプ、2つの材料選択ケースを固定テストセットとして用意します。プロンプト変更後はこのテストセットで一斉に再生成し、出力品質の差分を観察する仕組みを作ります。Custom GPTs に組み込んだ後でも、同じテストセットで定期評価を続けることで、モデルアップデートに伴う品質変動を早期に検知できます。

まとめ — Day 3 Custom GPTs への接続

Day 2 では ChatGPT プロンプトエンジニアリングの 2026年5月時点標準を整理しました。「think step by step」「Please try to」「This is extremely important」「You are a world-class expert…」といった旧定石が陳腐化し、CTCO Framework・reasoning.effort・verbosity・XML scaffolding が新標準となったことが要点です。

明日の Day 3 では、本日整理したプロンプト技法を Custom GPTs として再利用可能な資産に変換します。GPT Builder の操作手順、Knowledge ファイルの組み込み、Actions による外部 API 連携、GPT Store への公開とプライベート運用の使い分けまで、3Dプリント業務向けに3つの実装例(3D設計レビュー GPT、トラブルシュート GPT、材料選定 GPT)を作りながら解説します。

ChatGPT プロンプトの理論を Custom GPTs に固定化することで、業務知識が再現可能な資産となり、チームメンバーや顧客に共有できる形に進化します。Day 2 の構造化プロンプトは Day 3 の Custom GPTs の中身そのものになる、というのが Week 2 シリーズの設計思想です。

本日のキーアクションを3つにまとめます。第一に、過去に作った GPT-4o 時代のプロンプトを棚卸しすることです。「think step by step」「Please try to」「This is extremely important」「You are a world-class expert…」を含むプロンプトはすべて GPT-5.4 / 5.5 向けに書き直す対象です。OpenAI Cookbook の Prompt Optimizer を使えば自動マイグレートも可能で、初期評価には便利です。

第二に、CTCO Framework と XML scaffolding の2つを今日のうちに自分のプロンプト資産に取り入れることです。Context・Task・Constraints・Output の4段構造は、プロンプトに迷ったときの強力なテンプレートとなります。XML タグは業務用語ベースで命名するのがコツで、汎用的な <step1> ではなく <material_spec> のように具体名で書き分けます。

第三に、reasoning.effort と verbosity の2パラメータを意識的に使い分けることです。Custom GPTs 化や API 呼び出しでは、これらを業務シナリオごとに最適な値に設定するだけで、コストと品質のバランスが大きく変わります。Etsy 出品文は low/medium、不具合分析は high/low、材料比較は high/high、というように使い分けの型を覚えておくと、迷う時間が減ります。

明日の Day 3 では、これらの構造化 ChatGPT プロンプトを GPT Builder に投入し、Custom GPTs として「3D設計レビュー GPT」「トラブルシュート GPT」「材料選定 GPT」を実装します。Knowledge ファイル、Capabilities(Web Browsing、Code Interpreter、DALL-E)、Actions(外部 API)の使い分けまで含め、再利用可能な業務 GPT の設計図を提示します。プロンプトを「書く」段階から「資産化する」段階へ進む転換点となる回です。

この記事の内容は対応する YouTube 動画でも解説予定です。

参照

OpenAI 公式

- OpenAI Cookbook

- GPT-5 Prompting Guide

- GPT-5.1 Prompting Guide

- GPT-5.2 Prompting Guide

- Prompt Optimizer Cookbook

- Prompt Engineering | OpenAI API

- Reasoning Models Guide

- Introducing GPT-5.4

- GPT-5.4 Thinking System Card