[Beyond Copilot] 自律型AIエージェントアーキテクチャ2026: LangGraphで設計する「思考するシステム」

2025年、私たちは「Copilot」の便利さを享受しましたが、2026年は「Agent」の年です。

特に自律型AIの進化に注目が集まっています。

コードを補完するだけのAIから、複雑なタスクを計画

実行し、修正する「思考するシステム」への移行が始まっています。

この記事では、単なるチャットボットを超えた、堅牢な自律エージェントシステムのアーキテクチャを紹介します。

さらに、最新の LangGraph を用いて技術的に解説します。

なぜ「ただのLLMループ」は失敗するのか?

多くのエンジニアが最初に直面する壁、それは「プロンプトチェーンの限界」です。

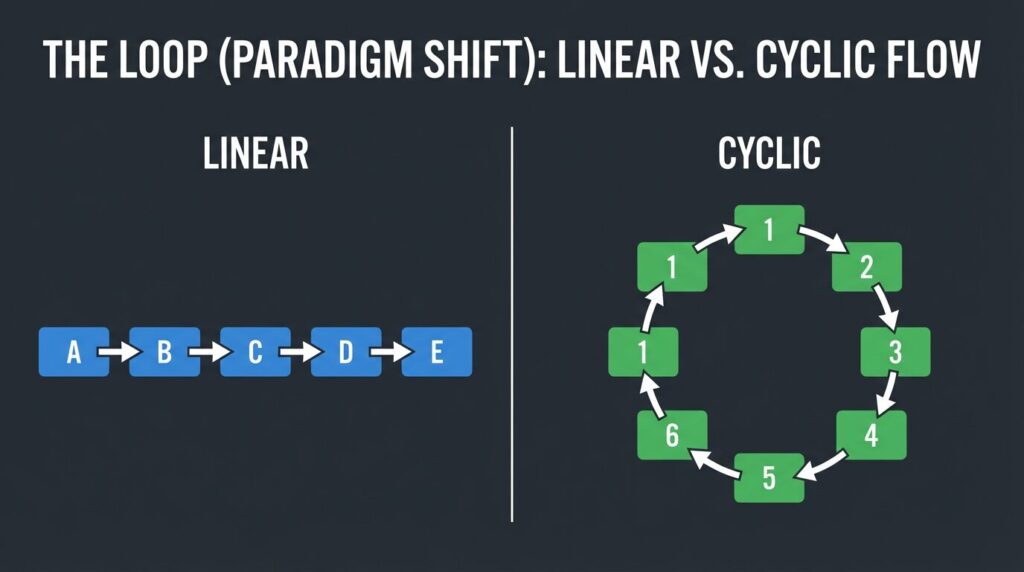

従来の線形なチェーン構造は、予測可能なタスクには適していますが、自律的な意思決定には不向きです。

- 状態保持の欠如: 以前のステップの失敗や中間生成物を記憶し続けることが難しい。

- 柔軟性のなさ: 「エラーが出たら調査に戻る」といった動的なループ処理を実装すると、コードがスパゲッティ化する。

- デバッグの困難さ: ブラックボックス化したエージェントのどこで判断を誤ったかを追跡できない。

これらを解決するのが、グラフ理論に基づいたステート管理です。

パラダイムシフト: “Graph” as a Brain

LangGraphは、エージェントのワークローを「有向グラフ」として定義します。

ここでの重要な概念は Cyclic Graph(循環グラフ) です。

人間が思考する際考え直すように、エージェントも「計画→実行→評価→再計画」というサイクルを回す必要があります。

コアコンポーネント

- State (Schema): エージェントの「短期記憶」。すべてのノードがアクセスし、更新できる共有データ構造。

- Nodes (Agents/Tools): 具体的な作業を行う関数。LLMの呼び出し、Web検索、コード実行など。

- Edges (Control Flow): 次にどのノードに進むかを決定するロジック。条件付きエッジにより動的なルーティングが可能になります。

技術的詳細: Orchestrator-Workers パターン

2026年の主流デザインパターンの一つ、「Orchestrator-Workers」の実装例を見てみましょう。

これは、中央の監督者がタスクを分解し、専門家エージェントに割り振るマイクロサービスのような構成です。

以下は LangGraph を使用した簡略化された Python 実装例です。

from typing import TypedDict, Annotated, List, Union

from langgraph.graph import StateGraph, END

from langchain_core.messages import BaseMessage

import operator

# 1. Stateの定義: メッセージ履歴と現在の担当エージェントを保持

class AgentState(TypedDict):

messages: Annotated[List[BaseMessage], operator.add]

next_agent: str

# 2. ノードの定義 (簡略化)

def orchestrator_node(state: AgentState):

# LLMが会話履歴を分析し、次に呼ぶべきエージェント(Researcher or Coder)を決定

# router_response = llm.invoke(...)

return {"next_agent": "Researcher"} # 仮の決定

def researcher_node(state: AgentState):

# Web検索を実行し、結果をメッセージに追加

return {"messages": [("ai", "Search Results: ...")]}

def coder_node(state: AgentState):

# コードを生成

return {"messages": [("ai", "def hello_world(): ...")]}

# 3. グラフの構築

workflow = StateGraph(AgentState)

workflow.add_node("Orchestrator", orchestrator_node)

workflow.add_node("Researcher", researcher_node)

workflow.add_node("Coder", coder_node)

# 4. エッジの定義 (動的ルーティング)

workflow.set_entry_point("Orchestrator")

def router(state: AgentState):

if state["next_agent"] == "Researcher":

return "Researcher"

elif state["next_agent"] == "Coder":

return "Coder"

return END

workflow.add_conditional_edges(

"Orchestrator",

router,

{"Researcher": "Researcher", "Coder": "Coder", END: END}

)

workflow.add_edge("Researcher", "Orchestrator") # 調査後は監督者に戻る

workflow.add_edge("Coder", "Orchestrator") # コード作成後も監督者に戻る

# 5. コンパイルと実行

app = workflow.compile()このアーキテクチャの美しさは、workflow.compile() によって生成されるランタイムにあります。

これはステートを永続化し、途中でプロセスが落ちても再開可能(Resumable)な基盤を提供します。

Human-in-the-Loop: 信頼のための最後の砦

自律エージェントを本番環境に投入する際、最も重要なのが Human-in-the-Loopです。

完全に自律させるのではなく、重要なアクションの前に「人間の承認」を挟みます。

LangGraphでは、interrupt_before を設定するだけでこれを実装できます。

# Coderがコードを書く前に一時停止

app = workflow.compile(interrupt_before=["Coder"])これにより、システムは Coder ノードに入る直前で停止します。

さらに、人間が現在の Stateを確認・修正した上で、resume コマンドを送るまで待機します。

これが、2026年の「信頼できるエージェント」の標準仕様です。

エージェント思考フローの可視化

この自律的なループ処理を視覚化すると、以下のようになります。

sequenceDiagram

participant User

participant Orchestrator

participant Worker (Researcher/Coder)

participant Memory (State)

User->>Orchestrator: タスク依頼

loop Agent Loop

Orchestrator->>Memory: 現在の状況を確認

Memory-->>Orchestrator: 履歴データ

Orchestrator->>Orchestrator: 計画立案・担当割当

alt 調査が必要

Orchestrator->>Worker (Researcher): 調査指示

Worker (Researcher)->>Memory: 検索結果を保存

else 実装が必要

Orchestrator->>Worker (Coder): コード作成指示

Worker (Coder)->>Memory: コードを保存

end

Worker (Researcher)-->>Orchestrator: 完了報告

end

Orchestrator->>User: 最終成果物を提出推奨スタック (2026 Edition)

堅牢なエージェントシステムを構築するための推奨スタックです。

- Orchestration: LangGraph (ステート管理と制御フロー)

- Validation: Pydantic (構造化データの検証。LLMの出力保証に必須)

- Tools: Tavily (エージェント用に最適化された検索API)

- Observability: LangSmith (エージェントの思考プロセス)

AIエージェントスキルで収益化す4つの方法

1. カスタムエージェント開発:企業の業務フローをLangGraphで自動化する受託開発です。カスタマーサポート、データ分析、レポート生成などのエージェントは1案件50〜200万円の相場です。

2. SaaS型エージェントプラットフォーム:特定業界向けの自律型AIエージェントをSaaSとして提供します。不動産、法務、人事などのニッチ分野で「業務特化型AIエージェント」の需要が急增中です。

3. 技術記事・オンライン講座:LangGraphの実装チュートリアルや動画講座を販売します。AIエージェント開発は日本語情報が少ないため、先行者利益があります。

4. エージェント監査コンサル:企業が導入したAIエージェントの品質監査や改善提案を行います。Human-in-the-Loopの設計、エラーハンドリング、コスト最適化など、専門知識が求められる分野です。

よくある質啎(FAQ)

Q1. LangGraphとLangChainの違いは?

LangChainはLLMアプリケーション構築のフレームワークで、LangGraphはその上に構築された状態機械ベースのエージェントフレームワークです。LangGraphは循環・分岐・並列実行などの複雑なフローをグラフ構造で定義できる点が最大の違いです。

Q2. LangGraph以外の選択肢は?

CrewAI、AutoGen、Semantic Kernelなどがあります。CrewAIはマルチエージェント協調に特化、AutoGenはMicrosoftが開発した会話型フレームワークです。状態管理の柔軟性ではLangGraphが最も優れています。

Q3. Human-in-the-Loopは必須ですか?

本番環境では強く推奨されます。特に財務、法務、医療などの重要な意思決定を伴う場合、人間の承認ステップを組み込むことで、幻覚や誤動作のリスクを大幅に低減できます。

Q4. エージェントのAPIコストはどのくらい?

モデルと利用頻度によりますが、GPT-4o使用時で1タスクあたり約0.01〜0.10ドル、Claude Sonnetではさらに低コストです。小さなタスクには軽量モデル、重要な判断には高性能モデルという使い分けが効果的です。

Q5. デバッグはどうすればいい?

LangSmith(LangChain提供の監視ツール)を使えば、各ノードの入出力、状態遷移、トークン使用量を可視化できます。またLangGraphのset_debug(True)で各ステップの詳細ログを出力可能です。

まとめ:自律型AIエージェントの始め方

LangGraphによるグラフベースのエージェント設計は、「ただのLLMループ」から「思考するシステム」へのパラダイムシフトです。Orchestrator-WorkersパターンとHuman-in-the-Loopを組み合わせることで、信頼性の高い自律型システムが構築できます。まずは小さなタスク(メール分類、FAQ回答など)でLangGraphを試し、段階的に複雑なワークフローへ拡張していきましょう。

あわせて読みたい

- 3Dプリンターの未来を変える2つの新技術【2026年版】Image-to-3D AIとベルトプリンター

- [Green Coding] なぜRustは2026年のクラウドネイティブインフラの未来なのか

- [DevSecOps] ゼロトラスト・パイプライン: OIDCとSigstoreで守るサプライチェーンセキュリティ

さらに詳しい情報はAll3DPでご覧いただけます。